2025-03|高质量中文预训练模型集合

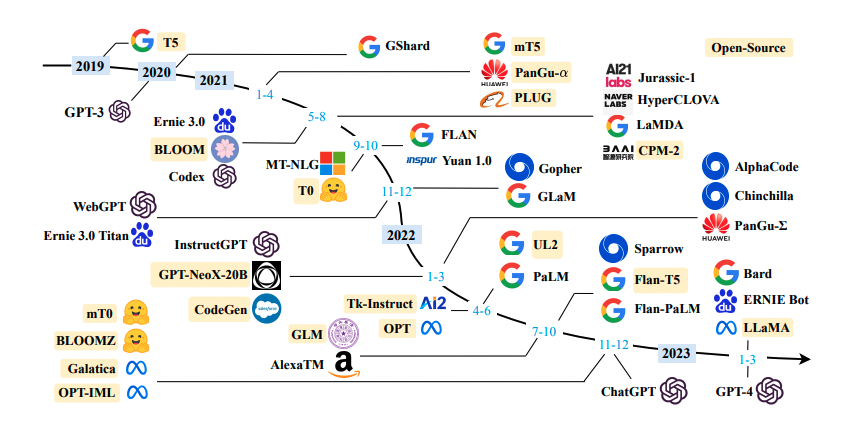

在自然语言处理领域中,预训练语言模型(Pretrained Language Models)已成为非常重要的基础技术,本仓库主要收集目前网上公开的一些高质量中文预训练模型(感谢分享资源的大佬),并将持续更新…

最新的模型汇总地址github: https://github.com/lonePatient/awesome-pretrained-chinese-nlp-models

Expand Table of Contents

更新日志

基础大模型

对话大模型

多模态对话大模型

大模型评估基准

在线体验大模型

开源模型库平台

开源数据集库

开源中文指令数据集

Other-Awesome

NLU系列

BERT

RoBERTa

ALBERT

NEZHA

XLNET

MacBERT

WoBERT

ELECTRA

ZEN

ERNIE

ERNIE3

RoFormer

StructBERT

Lattice-BERT

Mengzi-BERT

ChineseBERT

TaCL

MC-BERT

二郎神

PERT

MobileBERT

GAU-α

DeBE ...

Arxiv今日论文 | 2026-06-09

本篇博文主要内容为 2026-06-09 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-09)

今日共更新1412篇论文,其中:

自然语言处理共244篇(Computation and Language (cs.CL))

人工智能共510篇(Artificial Intelligence (cs.AI))

计算机视觉共277篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共438篇(Machine Learning (cs.LG))

多智能体系统共35篇(Multiagent Systems (cs.MA))

信息检索共 ...

Arxiv今日论文 | 2026-06-08

本篇博文主要内容为 2026-06-08 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-08)

今日共更新587篇论文,其中:

自然语言处理共88篇(Computation and Language (cs.CL))

人工智能共166篇(Artificial Intelligence (cs.AI))

计算机视觉共113篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共174篇(Machine Learning (cs.LG))

多智能体系统共10篇(Multiagent Systems (cs.MA))

信息检索共17 ...

Arxiv今日论文 | 2026-06-05

本篇博文主要内容为 2026-06-05 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-05)

今日共更新798篇论文,其中:

自然语言处理共153篇(Computation and Language (cs.CL))

人工智能共281篇(Artificial Intelligence (cs.AI))

计算机视觉共125篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共232篇(Machine Learning (cs.LG))

多智能体系统共11篇(Multiagent Systems (cs.MA))

信息检索共1 ...

Arxiv今日论文 | 2026-06-04

本篇博文主要内容为 2026-06-04 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-04)

今日共更新680篇论文,其中:

自然语言处理共126篇(Computation and Language (cs.CL))

人工智能共209篇(Artificial Intelligence (cs.AI))

计算机视觉共119篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共238篇(Machine Learning (cs.LG))

多智能体系统共12篇(Multiagent Systems (cs.MA))

信息检索共2 ...

Arxiv今日论文 | 2026-06-03

本篇博文主要内容为 2026-06-03 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-03)

今日共更新200篇论文,其中:

自然语言处理共31篇(Computation and Language (cs.CL))

人工智能共58篇(Artificial Intelligence (cs.AI))

计算机视觉共49篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共48篇(Machine Learning (cs.LG))

多智能体系统共5篇(Multiagent Systems (cs.MA))

信息检索共3篇(Inf ...

Arxiv今日论文 | 2026-06-02

本篇博文主要内容为 2026-06-02 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-02)

今日共更新1622篇论文,其中:

自然语言处理共268篇(Computation and Language (cs.CL))

人工智能共577篇(Artificial Intelligence (cs.AI))

计算机视觉共364篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共523篇(Machine Learning (cs.LG))

多智能体系统共36篇(Multiagent Systems (cs.MA))

信息检索共 ...

Arxiv今日论文 | 2026-06-01

本篇博文主要内容为 2026-06-01 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-06-01)

今日共更新761篇论文,其中:

自然语言处理共156篇(Computation and Language (cs.CL))

人工智能共226篇(Artificial Intelligence (cs.AI))

计算机视觉共147篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共265篇(Machine Learning (cs.LG))

多智能体系统共14篇(Multiagent Systems (cs.MA))

信息检索共2 ...

Arxiv今日论文 | 2026-05-29

本篇博文主要内容为 2026-05-29 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-05-29)

今日共更新902篇论文,其中:

自然语言处理共200篇(Computation and Language (cs.CL))

人工智能共354篇(Artificial Intelligence (cs.AI))

计算机视觉共170篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共289篇(Machine Learning (cs.LG))

多智能体系统共21篇(Multiagent Systems (cs.MA))

信息检索共2 ...

Arxiv今日论文 | 2026-05-28

本篇博文主要内容为 2026-05-28 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-05-28)

今日共更新897篇论文,其中:

自然语言处理共191篇(Computation and Language (cs.CL))

人工智能共372篇(Artificial Intelligence (cs.AI))

计算机视觉共133篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共274篇(Machine Learning (cs.LG))

多智能体系统共21篇(Multiagent Systems (cs.MA))

信息检索共3 ...